목적과 작업흐름

도구

딥 러닝 툴은 CNN(딥 컨벌루션 신경망)을 기반으로 합니다.

|

●

|

EasyClassify는 이미지를 사전 정의된 클래스 세트로 분류합니다. 이 도구를 사용하면 이미지에서 제품을 식별하거나 제품의 결함 여부를 감지할 수 있습니다. |

|

●

|

EasySegment Supervised는 이미지의 결함 및/또는 다양한 요소를 구분합니다. 감독 모드에서 훈련 이미지는 예상 분할(실측이라고도 함)과 함께 정확하게 주석을 달아야 합니다. |

|

●

|

EasySegment Unsupervised는 이미지의 결함을 감지하고 분할합니다. 이 도구는 감독되지 않은 방식으로 작동합니다. 이는 좋은 제품에 대해서만 훈련을 받았음을 의미합니다. |

좋은 제품이 무엇인지에 대한 모델만 만들고 결함이 있는 제품이 무엇인지에 대한 모델은 아닙니다.

|

□

|

장점은 도구가 데이터 세트에 없거나 예상치 못한 결함을 감지하고 분할할 수 있으며 예상 세분화로 이미지에 주석을 달 필요가 없다는 것입니다(매우 시간이 많이 소요될 수 있음). |

|

□

|

단점은 도구가 감지하고 분류할 수 있는 결함 유형이 명시적인 결함 모델을 작성할 때보다 더 제한적이라는 점입니다. |

|

□

|

EasySegment Unsupervised를 사용하여 에 필요한 이미지의 대략적인 주석을 생성할 수 있습니다.EasySegment Supervised |

|

●

|

EasyLocate locates objects and/or defects in images. The neural network predicts the location and the label of the object and/or defect. |

|

□

|

EasyLocate has two modes: |

- With EasyLocate Axis Aligned Bounding Box, the location of the object is represented by its bounding box.

- With EasyLocate Interest Point, the location of the object is represented by its position only.

|

□

|

EasyLocate works well with partially occulted objects. |

|

□

|

You can use it for defect detection, package verification and counting applications. |

|

□

|

Compared to EasySegment, it detects two objects or defects with the same label and that are overlapping or touching each other as two different objects or defects and not as a single blob. |

기존 머신 비전 기법과 달리 딥 러닝 툴은 이미지 내부에서 인식 및/또는 분류할 대상에 대한 명시적 모델이 필요하지 않습니다. 대신, 그들은 일련의 예제 이미지에서 이 모델을 학습합니다. 따라서 딥 러닝 툴은 명시적 모델이 너무 복잡하여 머신 비전 문제를 해결할 수 있습니다.

사양

| 최대 이미지 크기 |

128 × 128 |

64 × 64 |

128 × 128 |

| 최대 이미지 크기 |

1024 × 1024 |

10 000 × 10 000 |

500 000 pixels

(for ex. 707 × 707 for square image) |

| 최고 이미지 크기 |

256 × 256 - 600 × 600 |

해당하지 않음 |

해당하지 않음 |

| 채널 수 |

1 또는 3(그레이스케일 및 컬러 이미지) |

| 비트 심도 |

8비트, 16비트 |

| 라벨 수 |

2 - 1000 |

2 (좋은 것과 결함있는 것) |

2 - 64 |

| 라벨 당 최소 이미지 수 |

2 |

좋은 라벨은 1

결함있는 라벨은 0 |

1 |

| 지원 형식 |

bmp, png, jpeg, j2k, tiff |

계산 속도를 높이려면 최신 NVIDIA GPU에서 딥 러닝 툴을 실행하는 것이 좋습니다. 필요한 NVIDIA CUDA 및 심층 학습 라이브러리 설치 섹션Engines and Hardware Support (CPU/GPU)을 참조하십시오.

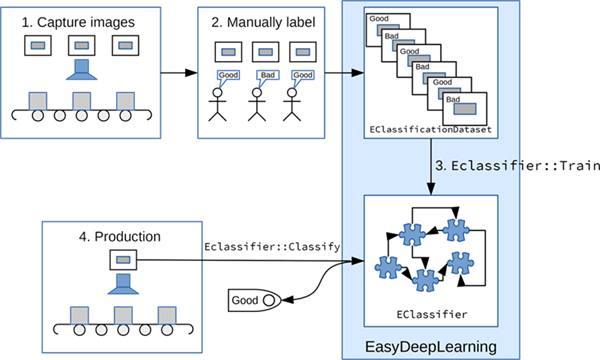

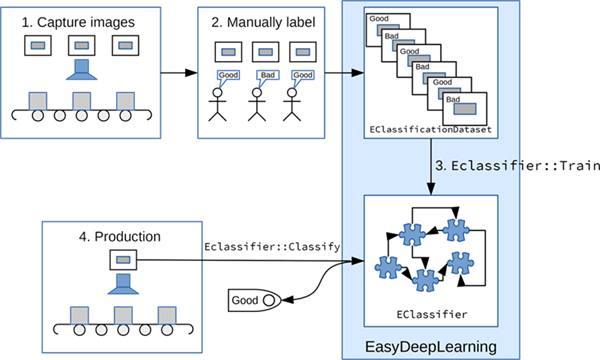

작업흐름

딥 러닝 툴을 기반으로 애플리케이션을 만들려면:

|

1.

|

해결하려는 문제를 나타내는 이미지의 데이터 세트를 캡처하십시오. |

|

□

|

캡처 조건은 가능한 한 생성 조건에 비슷해야 합니다. |

|

□

|

모든 이미지는 동일한 해상도를 가져야 합니다. |

|

□

|

좋은 성능을 얻는 데 필요한 이미지 수는 작업의 복잡성과 사용된 도구에 따라 다릅니다. |

|

□

|

With EasyClassify, you can use the training with as few as 10 images per label. Nevertheless, complex tasks may require more than 100 images per label. |

|

□

|

With EasySegment Unsupervised, you can use less than 10 “good” images. Nevertheless, complex tasks may require more than 100 “good” images. |

|

□

|

With EasySegment Supervised, the required number of images depends on the size and the number of elements to segment in each image. You can use as few as 10 elements per label. Nevertheless, complex tasks may require more than 100 elements per label. |

|

□

|

With EasyLocate, the number of images depends on the number of objects/defects in the images. You can use as few as 10 objects per label. Nevertheless, complex tasks may require more than 100 objects per label. |

|

□

|

해상도와 이미지 수에 대한 제약 사항은 각 도구의 사양을 참조하십시오. |

|

2.

|

인식하려는 다른 범주로 데이터 세트의 이미지에 수동으로 레이블을 지정합니다. |

이 범주는 도구에 따라 다릅니다:

|

□

|

EasyClassify:

- 각 이미지는 하나의 범주에만 해당해야 합니다.

- 범주는 2개 이상 있어야 합니다. |

|

□

|

EasySegment Unsupervised:

- 좋은 샘플 이미지를 위한 단일 범주.

- 결함이 있는 샘플의 이미지에 대해 원하는 범주(없음 포함) |

|

□

|

EasySegment Supervised:

- 실측 분할로 이미지의 픽셀에 주석을 달아야 합니다.

-레이블 외에 분할 레이블이 하나 이상 있어야 합니다.Background |

- For EasyLocate Axis Aligned Bounding Box, you must annotate the defects or the objects with a bounding box and a label.

- For EasyLocate Interest Point, you must annotate the defects or the objects with their position and a label.

Use the class EClassificationDataset to compile your labeled images.

All deep learning tools are child classes of the class EDeepLearningTool:

|

4.

|

데이터 세트에서 딥 러닝 툴을 훈련시킵니다. |