하드웨어 지원 (CPU/GPU)

CPU 사용

|

●

|

딥 러닝 알고리즘은 많은 계산을 수행하며 CPU에서 훈련하는 속도가 매우 느립니다. |

예를 들어 EasyClassify의 경우 데이터 증가없이 단일 스레드가 있는 고급 Intel Core i9-7900X CPU에서 :

|

□

|

이 훈련 과정은 초당 최대 0.5메가 픽셀을 처리할 수 있습니다. |

|

□

|

검증 및 분류는 초당 최대 1.5메가 픽셀까지 처리할 수 있습니다. |

딥 러닝 툴은 32비트 및 64비트 애플리케이션 모두에 대해 CPU 처리를 지원합니다. 그러나 32비트 응용 프로그램의 메모리는 2GB로 제한되며 이로 인해 큰 이미지의 학습 또는 분류가 느려질 수 있습니다.

NVIDIA CUDA® GPU 사용

|

●

|

최근 NVIDIA GPU를 사용하면 처리 속도가 크게 빨라집니다. |

EasyClassify의 경우, 데이터 증강없이 NVIDIA GeForce 1080Ti에서:

|

□

|

이 훈련 과정은 초당 최대 50메가 픽셀을 처리할 수 있습니다. |

|

□

|

검증은 초당 최대 160메가 픽셀 까지 처리할 수 있습니다. |

|

□

|

단일 이미지의 분류는 초당 최대 55메가 픽셀을 처리할 수 있습니다 (초당 800×256 그레이 스케일 이미지와 동일). |

실제 속도는 입력 이미지 형식, 데이터 증가, 배치 크기 및 GPU 모델에 따라 다릅니다.

|

1.

|

딥 러닝 툴과 함께 NVIDIA GPU를 사용하려면 컴퓨터에 다음 NVIDIA 라이브러리를 설치하십시오. |

|

□

|

NVIDIA CUDA® 툴킷을 기본 위치(C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v10.0)에 설치하면 딥 러닝 툴이 필요한 것을 자동으로 찾습니다. |

|

□

|

그렇지 않으면, DLL cusolver64_100.dll, curand64_100.dll, cufft64_100.dll를 Open eVision DLL 폴더 (기본 위치는 C:\Program Files (x86)\Euresys\Open eVision X.X\Bin64\)를 복사합니다. |

|

3.

|

압축 아카이브로 제공되는 NVIDIA CUDA ® Deep Neural Network 라이브러리 (cuDNN)를 설치하십시오. |

|

c.

|

NVIDIA CUDA® Toolkit이 기본 위치에 설치되어 있지 않은 경우 Open eVision DLL 폴더 (기본 위치는 C:\Program Files (x86)\Euresys\Open eVision X.X\Bin64\)에 cudnn64_7.dll 파일을 복사하십시오. . |

|

4.

|

방법을 사용하여 딥 러닝 툴과 함께 GPU를 사용합니다. |

|

●

|

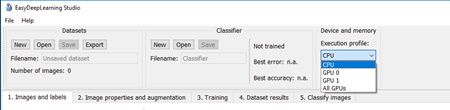

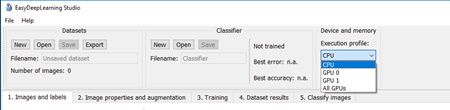

Deep Learning Studio에서 처리 장치를 선택하려면 실행 프로파일을 선택하십시오. |

|

●

|

이러한 실행 프로필을 필요에 맞게 구성할 수 있습니다. |

|

●

|

32 비트 응용 프로그램에서는 GPU 처리가 불가능합니다. |

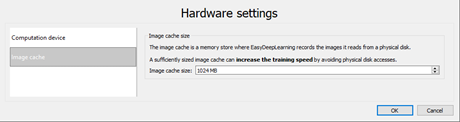

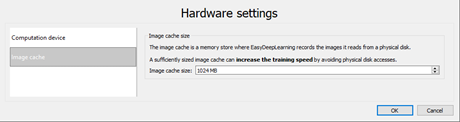

이미지 캐시

이미지 캐시는 학습 중에 이미지를 저장하기 위해 예약된 메모리의 일부입니다.

|

●

|

큰 데이터 세트를 사용하면 이미지 캐시 크기를 늘리면 교육 속도가 향상될 수 있습니다. |

캐시 크기를 바이트 단위로 지정하려면 다음을 수행하십시오:

|

●

|

Deep Learning Studio에서는 Execution profile 컨트롤 아래의 Configure 버튼을 클릭하고 메뉴에서 Image cache를 선택하십시오. |

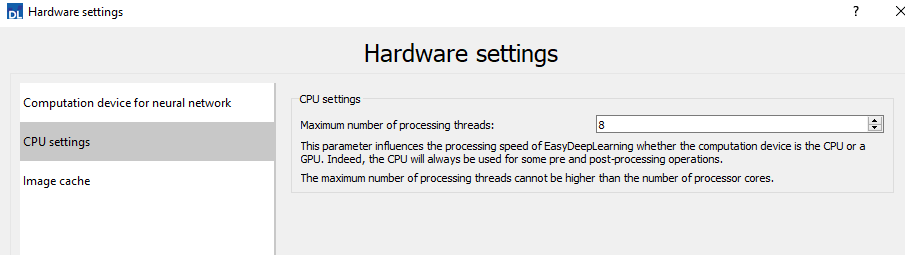

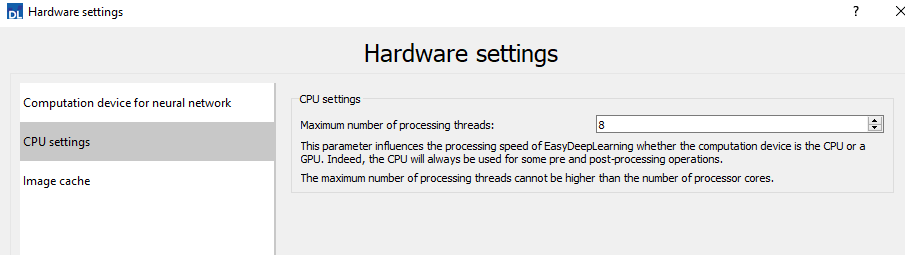

멀티코어 처리

딥 러닝 툴은 멀티 코어 처리를 지원합니다 (멀티코어 처리 참조).

|

●

|

Deep Learning Studio에서는 Execution profile 컨트롤 아래의 Configure 버튼을 클릭하고 메뉴에서 CPU Settings을 선택하십시오. |